Dans un précédent article, on posait un diagnostic simple : projets IA bloqués au stade POC, données dispersées, architecture conçue pour le reporting, gouvernance et temps réel repoussés à plus tard. Mais avoir le diagnostic ne suffit pas.

La question suivante est toujours la même : par où commencer ? Et surtout : avec quel cadre de lecture pour éviter d’ajouter un outil de plus à une architecture déjà fragile ?

Derrière trois notions très présentes dans les publications d’analystes (data convergence, data fabric, AI-ready data) il y a une seule question :

Est-ce que votre architecture permet de décider vite sur des données fiables sans rajouter 10 outils ?

Ce que le marché est en train de faire sans vous consulter

Le meilleur indicateur d’une tendance, ce n’est pas le discours marketing. C’est le mouvement réel des plateformes.

- Des acteurs nés dans l’analytique élargissent leur périmètre pour adresser des usages plus opérationnels .

- Les analystes décrivent une trajectoire qui va d’une “modern data stack” éclatée vers des approches plus convergées : architectures de type data fabric, puis data management platforms plus intégrées, puis des data ecosystèmes.

- Et ils emploient explicitement la notion de “converged” pour parler du lakehouse : un environnement d’infrastructure convergé combinant l’approche lake et des capacités type warehouse, visant aussi à réduire les redondances de plateformes/outils.

En clair, le marché cherche à réduire le coût du bricolage (copies, intégrations, outillage redondant) pour rendre possible ce que l’IA exige : des décisions plus proches du temps réel, traçables, gouvernées.

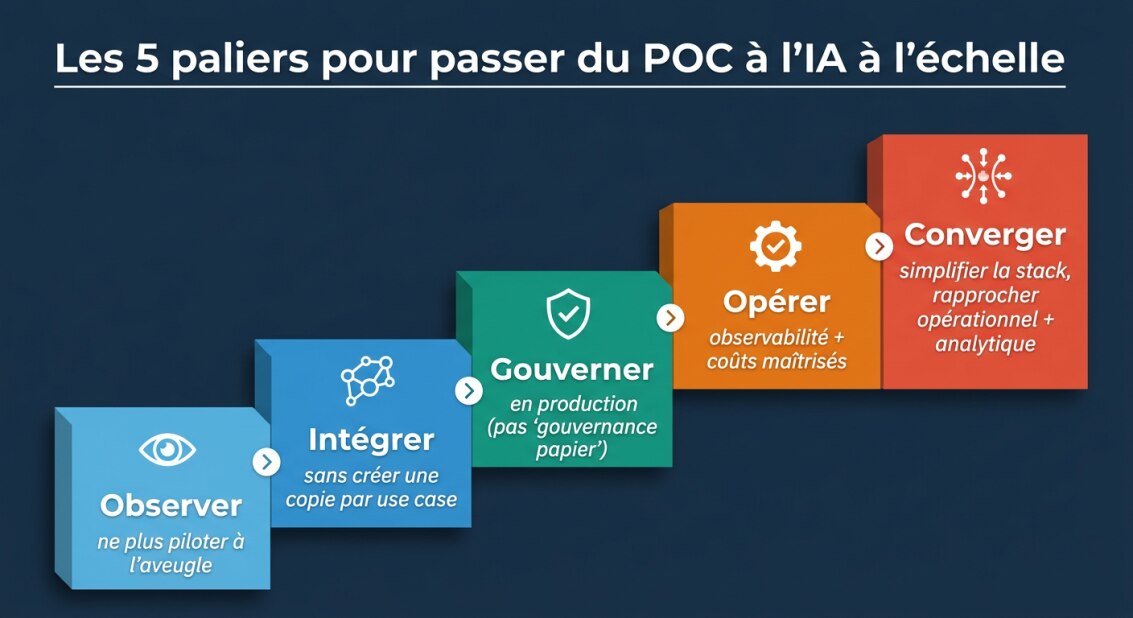

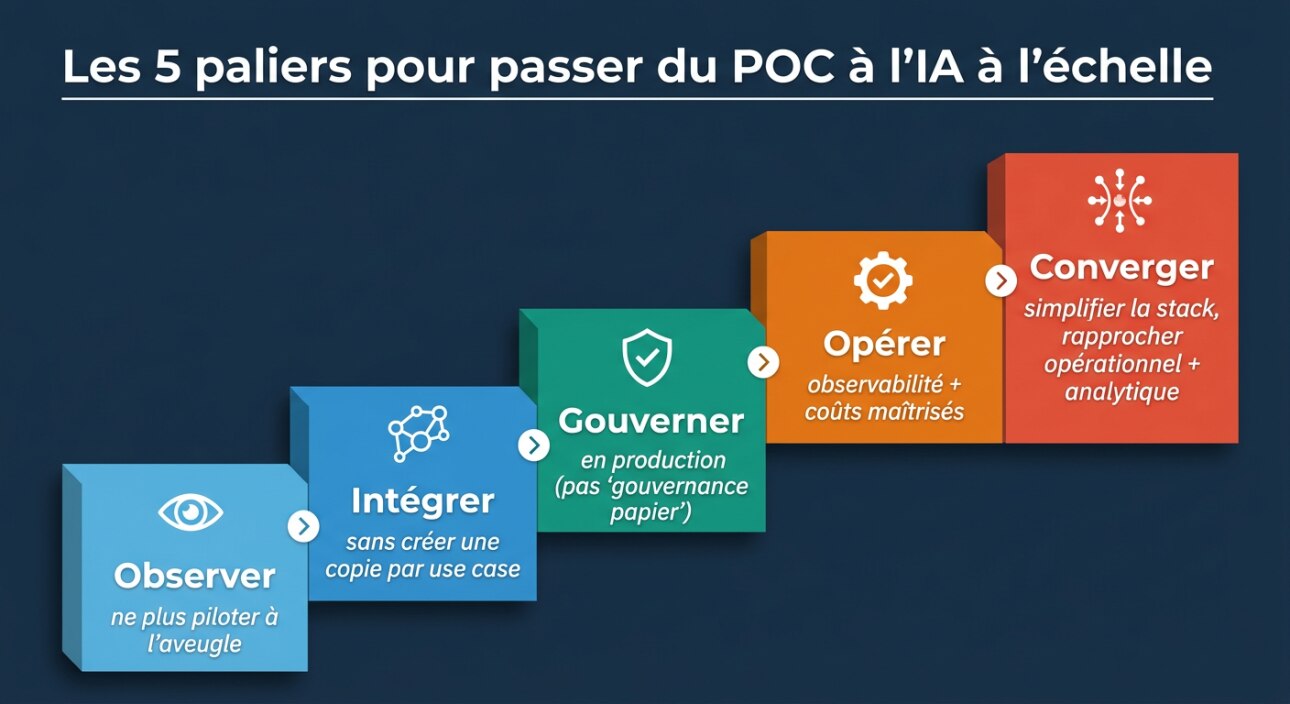

Les 5 paliers à franchir pour passer du POC à l’IA à l’échelle

Plutôt qu’un audit “technique”, voici une lecture en paliers.

L’idée est simple : vous vous situez, vous identifiez ce qui manque pour franchir le palier suivant, puis vous priorisez un chantier qui réduit vraiment la complexité.

Palier 1 : Observer

Vous instrumentez votre data : métadonnées, usages réels, dérives.

Objectif : savoir où ça casse avant que les métiers ne le constatent.

Palier 2 : Intégrer

Vous standardisez les patterns d’intégration (batch + temps réel là où c’est utile) et vous évitez de recréer un pipeline “sur mesure” à chaque nouveau besoin IA.

Objectif : alimenter les cas d’usage IA avec des données suffisamment fraîches, sans recréer un pipeline et une copie à chaque nouveau besoin.

Palier 3 : Gouverner en production

Traçabilité, qualité, contrôle d’accès, règles : tout doit être opérable.

Objectif : pouvoir expliquer et sécuriser ce qui alimente les modèles et les décisions.

Palier 4 : Opérer

Vous détectez les dérives (qualité, fraîcheur, schéma, coûts, latence) et vous maîtrisez le run/FinOps.

Objectif : scaler sans exploser la charge d’exploitation.

Palier 5 : Converger

Vous rationalisez la stack et vous réduisez les redondances.

Pour les cas d’usage opérationnels, vous rapprochez transactionnel et analytique au bon moment, au lieu de rester coincé dans le batch

Objectif : réduire durablement la complexité (outils redondants, copies, intégrations) et permettre des décisions opérationnelles en temps utile, sans surcoût de run.

Le schéma ci-dessous résume ces 5 paliers en une vue.

Les 5 paliers pour passer du POC à l’IA à l’échelle :

observer → intégrer → gouverner → opérer → converger.

Quatre concepts à maîtriser pour lire ce marché

1) Data Convergence

En pratique : réduire l’empilement d’outils et aller vers des plateformes plus cohésives, capables de servir plusieurs workloads (analytique, IA, temps réel) dans un environnement mieux intégré.

Pourquoi ça compte : chaque couche ajoutée (un outil, une copie, un pipeline) crée de la latence, de la dette d’intégration, plus de run et plus de coûts cachés. La convergence vise à réduire cette complexité.

Exemple simple : si chaque nouveau cas d’usage (dashboard, modèle IA, service) déclenche “un nouveau pipeline + une nouvelle copie”, vous êtes dans une logique d’empilement.

2) Convergence transactionnel + analytique

En pratique : rapprocher données opérationnelles (transactions/événements) et calculs analytiques/IA au bon moment, sans pipelines longs, sans batch par défaut, sans contournements Excel.

Pourquoi ça compte : c’est ce qui permet de décider et d’agir plus vite, sur des données plus fraîches, avec moins de copies et plus de contrôle (qualité, traçabilité, sécurité).

Exemple simple : un agent IA qui arbitre une commande a besoin du stock à l’instant T (transactionnel) et des contraintes/règles/prévisions (analytique) au même moment. Si ces mondes restent trop séparés, l’IA produit des recommandations “en retard” ou difficilement actionnables.

3) Data Fabric

En pratique : une approche d’architecture (pas un produit unique) pour unifier l’accès à des données dispersées, en s’appuyant sur les métadonnées (catalogue, sémantique, qualité, traçabilité) et l’orchestration.

Pourquoi ça compte : elle sert de “colle” entre l’existant et les nouveaux usages (analytics, IA, temps réel) en rendant la gouvernance et les règles réutilisables — plutôt que de refaire les mêmes traitements à chaque projet.

Exemple simple : au lieu de recoder des règles de qualité et d’accès dans chaque pipeline ou chaque projet, vous les définissez une fois (définitions, droits, contrôles) et vous les appliquez partout de façon cohérente.

4) AI-ready data

En pratique : des données exploitables pour l’IA parce qu’elles sont fiables, traçables (lineage), contextualisées (définitions/sémantique), sécurisées, et suffisamment fraîches pour le cas d’usage.

Pourquoi ça compte : l’IA amplifie ce qu’on lui donne. Si la donnée est incohérente ou mal gouvernée, le modèle produit des recommandations erronées — et personne ne sait expliquer pourquoi. Résultat : perte de confiance et risques accrus.

Exemple simple : si un KPI (ex. stock) existe en plusieurs versions ou si personne ne peut dire quelles tables/champs ont alimenté une recommandation, l’IA devient un générateur d’arbitrages contestables — donc elle ne passera pas en production.

Repère : 5 critères DSI : êtes-vous prêt à franchir le palier suivant ?

- Copies & latence : combien d’étapes entre la source et l’usage IA/analytics ?

- Une seule version des KPI : débat-on encore du chiffre ou de la décision ?

- Traçabilité & contrôle : peut-on expliquer “d’où vient la donnée” et qui y accède ?

- Opérationnel + analytique (quand nécessaire) : peut-on décider au bon moment sans rajouter 3 couches ?

- Run & coûts : la stack est-elle exploitable et financièrement prévisible ?

Comment utiliser cette lecture en interne ?

- Choisissez deux cas d’usage IA : un “analytique” et un “opérationnel”.

- Situez-vous : à quel palier bloquez-vous aujourd’hui ?

- Priorisez un chantier de franchissement (pas cinq).

- Mesurez l’impact : réduction des copies, baisse de latence, meilleure traçabilité, moins d’incidents, coûts plus lisibles.

Transition vers la suite (et vers le choix des fournisseurs)

Le passage à l’échelle n’est pas un sujet d’algorithmes, mais d’architecture data. Pour identifier les plateformes alignées avec cette trajectoire (convergence, temps réel, AI-ready data), le Gartner MQ Cloud DBMS est un bon repère.

Pour aller plus loin

Télécharger le Gartner Magic Quadrant Cloud DBMS 2025 (gratuit via formulaire)

https://www.intersystems.com/fr/gartner-magic-quadrant-cdbms/