Chez InterSystems, nous entretenons un dialogue actif et continu avec les principaux analystes spécialisés dans la gestion des données. Cela nous permet de rester en phase avec l’évolution de leur lecture du marché, de partager les enseignements tirés de notre travail avec nos clients et partenaires, et de les tenir informés de nos dernières innovations et évolutions produits.

Dans un contexte de transformation rapide, deux thèmes s’imposent comme particulièrement critiques et structurants pour fournir une IA plus rapide, plus fiable et plus digne de confiance : les plateformes de données convergentes et les données prêtes pour l’IA.

Plateformes de données convergentes

Gartner et de nombreux autres analystes, tout comme beaucoup d’entreprises avec lesquelles nous collaborons, constatent l’émergence et l’importance de ce qu’ils appellent des plateformes de données convergentes. Ces plateformes réduisent la complexité, améliorent les performances et l’efficacité, diminuent les coûts en convergeant, c’est-à-dire en combinant plusieurs services de gestion des données qui, jusqu’ici, existaient sous forme de services indépendants, au sein d’une offre unifiée.

Les plateformes de données convergentes offrent de nombreux avantages, en particulier pour les initiatives d’IA et d’IA générative. Beaucoup d’éditeurs abordent la convergence en se contentant d’assembler des services indépendants, reposant sur des architectures différentes, et nécessitant chacun sa propre copie des données. Notre approche, au contraire, consiste à fournir l’ensemble de ces capacités, gestion de bases de données multi-modèles et multi-workloads, intégration, orchestration de services, ainsi que diverses capacités analytiques, dans un moteur unique, conçu dès l’origine, et reposant sur une représentation unifiée de la donnée : notre « common data plane ». Cette approche de la convergence se traduit par des architectures plus simples, un ROI plus élevé, une fragilité réduite, l’élimination des duplications de données, et des données plus fiables pour les projets d’IA, grâce à un modèle unifié de sécurité, de gouvernance, de traçabilité et de sémantique, applicable à l’ensemble des données.

Vous trouverez ci-dessous plusieurs rapports d’analystes illustrant cette tendance vers les plateformes de données convergentes, accompagnés d’extraits sélectionnés. Tous les rapports mentionnés dans cet article sont disponibles gratuitement auprès d’InterSystems.

« Les organisations sont confrontées à la prolifération de services de gestion des données en silos, et peinent souvent à administrer un nombre croissant de systèmes spécialisés, tout en faisant face à une complexité opérationnelle accrue, à des obligations de conformité et à des enjeux d’optimisation des coûts. Les entreprises — en particulier celles disposant de ressources limitées ou confrontées à un manque d’effectifs techniques — reconnaissent de plus en plus que les stratégies best-of-breed génèrent une complexité difficilement soutenable. Elles s’orientent donc progressivement vers des plateformes convergentes offrant une gestion rationalisée, une plus grande simplicité opérationnelle et une sécurité intégrée. En conséquence, le marché connaît une évolution de fond vers des solutions convergentes intégrant des modèles de données documentaires, graphe, relationnels et vectoriels, ainsi que des capacités d’intégration et de gestion des données. »

« La convergence des exigences liées aux bases de données multi-modèles, des besoins d’analytique en temps réel et des impératifs de sécurité renforcés constitue un argument solide en faveur de l’adoption d’InterSystems IRIS®. Pour comprendre le décalage entre une première adoption d’une plateforme de données et les réévaluations qui suivent, Nucleus a interrogé plusieurs organisations ayant migré vers InterSystems IRIS après avoir rencontré des difficultés avec leur stratégie initiale de gestion des données. Les clients ont cité la convergence, la prise en charge de déploiements à l’échelle de l’entreprise et la fatigue liée à l’empilement de solutions « par composants » comme facteurs clés de ce changement. Selon eux, l’adoption d’InterSystems IRIS a permis jusqu’à 98 % d’amélioration de la précision du filtrage des risques et des sinistres, ainsi que la consolidation de centaines à milliers de services de gestion des données. Alors que les exigences envers les plateformes de données continuent d’augmenter — pour prendre en charge de nouveaux workloads et des volumes de données croissants — Nucleus s’attend à ce qu’InterSystems devienne une destination privilégiée pour les entreprises, à mesure qu’elles dépassent les architectures « par composants » afin de gagner en efficacité et de réduire les coûts. »

Les IDC MarketScape proposent des évaluations approfondies, quantitatives et qualitatives, des fournisseurs sur un large éventail de marchés technologiques. Cette édition consacrée aux bases de données analytiques offre une analyse complète des 14 principaux fournisseurs du segment, ainsi que les observations d’IDC sur le marché et des recommandations à destination des acheteurs de technologies.

« Le marché des bases de données analytiques entre dans une nouvelle phase d’innovation, alors que les avancées des architectures de stockage et de calcul redéfinissent la manière dont les entreprises tirent de la valeur de leurs données. Pour les acheteurs, cette étude fournit un cadre stratégique permettant d’évaluer les bases de données analytiques selon trois critères clés : la flexibilité, l’interopérabilité et la préparation à l’IA — les nouveaux moteurs de différenciation concurrentielle dans l’analytique d’entreprise.

Les organisations devraient envisager des charges de travail convergentes (workloads) reposant sur des architectures HTAP (Hybrid Transactional and Analytical Processing) pour la prise de décision en temps réel. Les plateformes analytiques modernes prennent de plus en plus en charge des charges de travail convergentes, unifiant traitements transactionnels et analytiques au sein d’un même système. Le HTAP permet d’analyser des données opérationnelles en direct, sans réplication ni latence, constituant ainsi un socle pour la décision en temps réel. Les acheteurs doivent évaluer si ces capacités répondent à des besoins tels que la détection de fraude, la personnalisation ou la visibilité de la chaîne d’approvisionnement, tout en préservant l’intégrité transactionnelle et les performances analytiques sur les mêmes données. Les plateformes capables de supporter ces deux types de charges de travail améliorent la réactivité, réduisent les déplacements de données et renforcent la gouvernance. Les architectures HTAP deviennent également essentielles pour l’IA agentique, où des données en temps réel, riches en contexte, permettent une prise de décision autonome et pilotée par les données à l’échelle de l’entreprise.

Après une évaluation approfondie des stratégies et des capacités d’InterSystems, IDC a positionné l’entreprise dans la catégorie Leaders de cette édition 2025 de l’IDC MarketScape consacrée aux bases de données analytiques dans le monde. InterSystems IRIS unifie, au sein d’un moteur unique, les modèles relationnel, documentaire, clé-valeur, objet, vectoriel et séries temporelles. Cette approche multi-modèle permet aux entreprises de prendre en charge des charges de travail opérationnelles, analytiques et de nouveaux usages pilotés par l’IA, sans dépendre de multiples systèmes. InterSystems IRIS réduit les duplications et accélère l’accès aux analyses. »

Données prêtes pour l’IA

Il existe de nombreuses citations d’analystes, rapports et retours d’expérience qui qualifient et quantifient l’importance de données prêtes pour l’IA dans la réussite des projets d’IA. Par exemple, une enquête Gartner menée auprès de dirigeants IT indique que seulement 4 % des entreprises considèrent que leurs données sont prêtes pour l’IA (Gartner, Top Trends in Data and Analytics, 2024), et les résultats de l’enquête BARC montrent que les problèmes de données figurent parmi les principaux obstacles au succès de l’IA. Nos clients nous expliquent que notre approche — fournir des données prêtes pour l’IA via une couche globale de smart data fabric non disruptive, s’appuyant sur une architecture convergente et des mécanismes communs de sécurité, de traçabilité (lineage), de gouvernance et de sémantique — est un prérequis pour obtenir des résultats probants en IA et en IA générative.

Par ailleurs, l’intégration de capacités d’IA embarquées couvrant plusieurs formes d’IA — notamment l’analytique prédictive et prescriptive, ainsi que l’IA générative (GenAI), le RAG, les agents et les fonctionnalités vectorielles — élimine la nécessité de copier les données dans des environnements séparés pour les traitements analytiques. Cela améliore l’efficacité, réduit la latence et diminue les risques d’erreur.

Vous trouverez ci-dessous des rapports clés qui soulignent l’importance de données prêtes pour l’IA.

Ce rapport Gartner regorge de résultats d’enquête et de recommandations sur le caractère critique des données prêtes pour l’IA, ainsi que sur les évolutions nécessaires des architectures, des plateformes et des processus data pour réussir des initiatives IA.

« Les responsables data et analytics (D&A) subissent une pression extrême pour soutenir les efforts IA urgents et critiques de leur organisation. Si la plupart des organisations ont investi au fil des ans dans des architectures et des pratiques traditionnelles de gestion des données, celles qui ne prennent pas la mesure des différences entre les exigences de données prêtes pour l’IA et la gestion traditionnelle des données mettront en péril la réussite de leurs projets IA. »

Les analyses Gartner montrent notamment que :

- Le manque de données figure parmi les trois principaux freins à la mise en œuvre de techniques d’IA pour près de 40 % des répondants à l’enquête Gartner AI in the Enterprise Survey 2023.

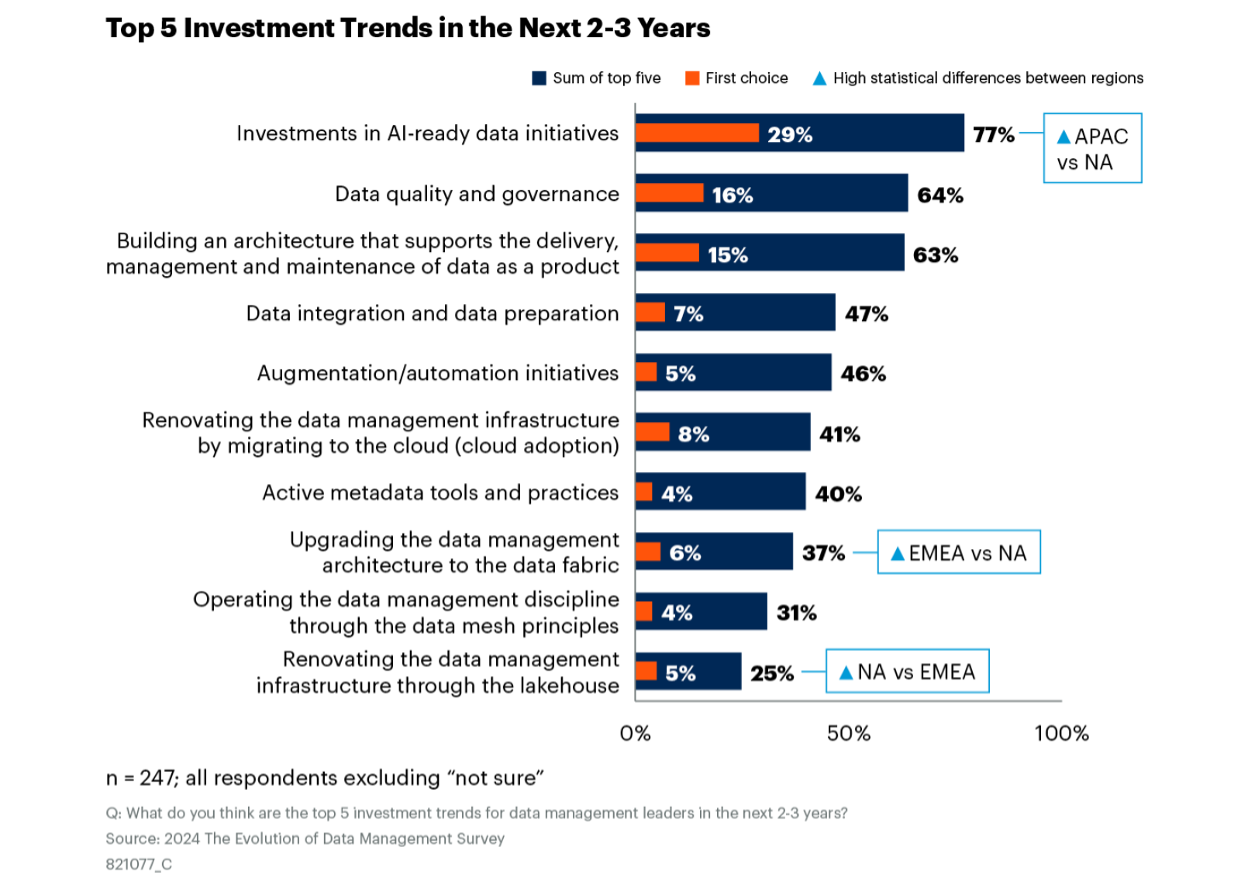

- Plus de 75 % des organisations indiquent que les données prêtes pour l’IA resteront l’un de leurs cinq principaux domaines d’investissement au cours des deux à trois prochaines années, selon l’enquête Gartner 2024 – Evolution of Data Management as a Dedicated Function Survey.

Gartner, Inc. (2024). Evolution of Data Management In A Journey Guide to Deliver AI Success Through AI‑Ready Data. Gartner.

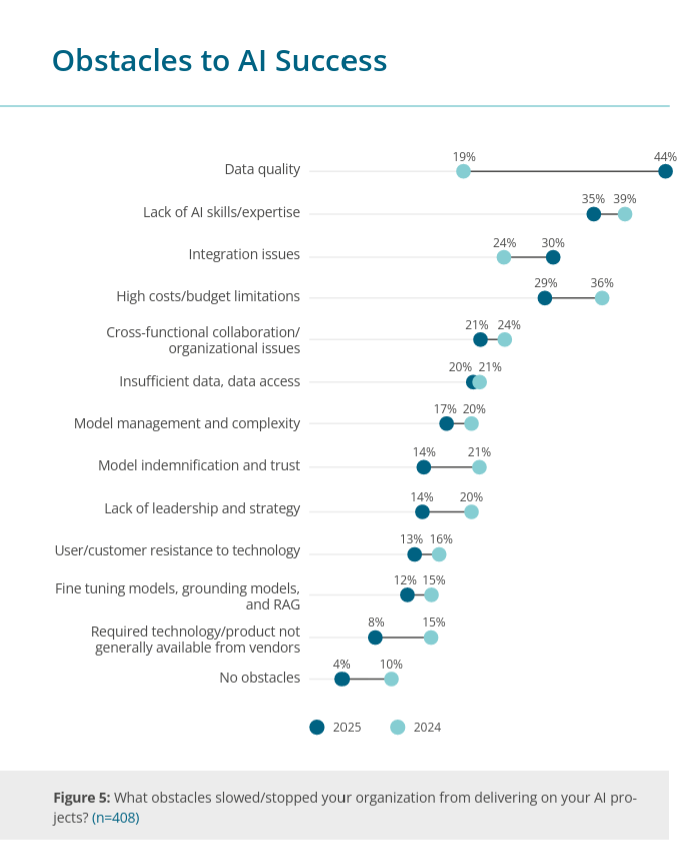

Selon une enquête récente de BARC menée auprès de 421 organisations dans le monde, trois des six principaux obstacles à la réussite des projets d’IA sont liés aux données — notamment la qualité des données (n°1), les problèmes d’intégration (n°3) et l’insuffisance des données / l’accès insuffisant aux données. Cela confirme que des données prêtes pour l’IA sont indispensables à la réussite des projets d’IA — et que le sujet reste un défi non résolu.

« La qualité des données est passée devant tous les autres obstacles. Dans les résultats 2024, la qualité des données était classée à 19 %, dans le tiers inférieur des défis mentionnés. À mesure que davantage de projets ont été livrés, la qualité des données est devenue, en 2025, le premier obstacle à la réussite des projets d’IA : 44 % des répondants la citent comme le principal défi. Le vieil adage “garbage in, garbage out” est aussi vrai pour l’IA que pour l’analytique traditionnelle. Une mauvaise qualité de données affecte le contexte des résultats, et donc la précision. La leçon est claire : ne pas traiter durablement les problèmes de qualité des données limitera la capacité de votre entreprise à délivrer des projets d’IA à fort impact. »

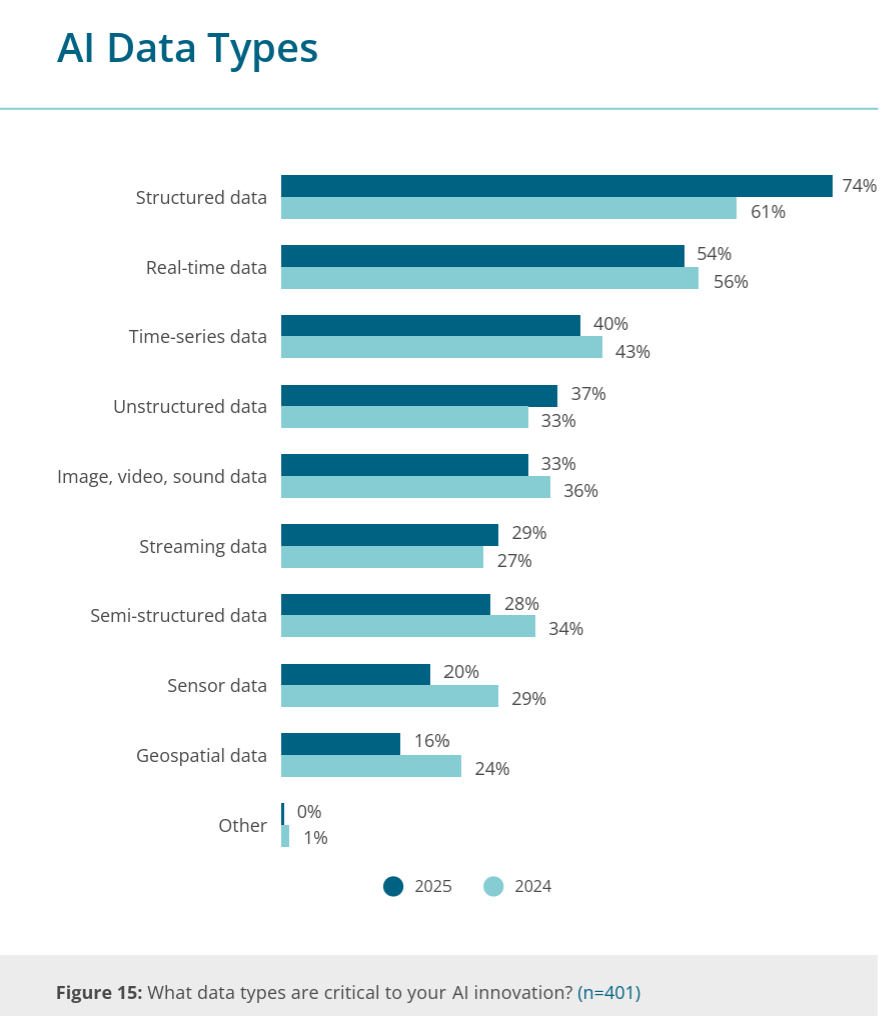

Un autre enseignement important de l’enquête concerne la nécessité de gérer des données en temps réel et différentes formes de données non structurées. Or, cela reste un défi pour de nombreuses organisations, car beaucoup de fournisseurs de gestion des données se concentrent encore principalement sur des données structurées et traitées en mode batch.

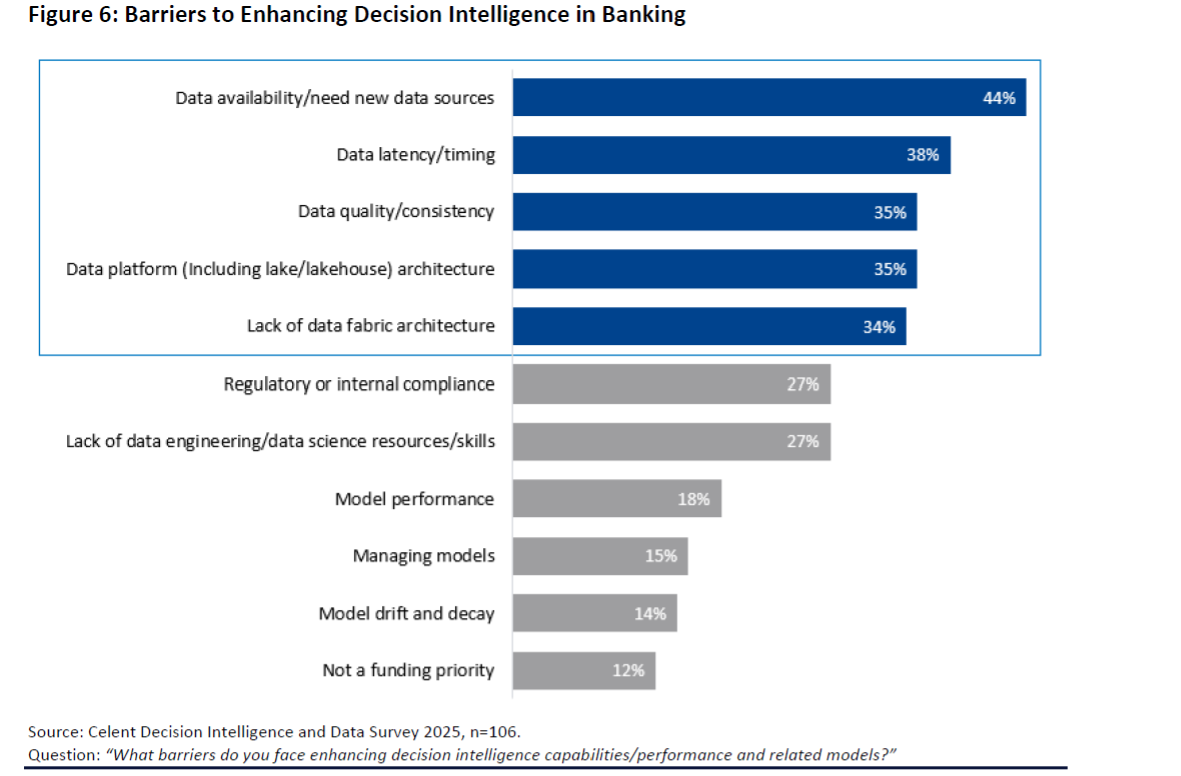

Celent est un cabinet d’analystes reconnu, spécialisé dans le secteur bancaire. Ce rapport présente les résultats d’une enquête (sponsorisée par InterSystems) menée auprès de plus de 100 dirigeants bancaires en Amérique du Nord et au Royaume-Uni. Les principaux enseignements sont que les banques investissent pour améliorer les performances de leurs modèles d’IA (decision intelligence) — par exemple pour la fraude, le traitement des paiements, le risque de crédit, la connaissance client, l’octroi de prêts, etc. — et que les principaux défis identifiés portent tous sur le besoin de meilleures données. À noter : les cinq principaux freins cités par les banques pour renforcer la decision intelligence (modèles d’IA) sont tous liés à des problématiques de données.

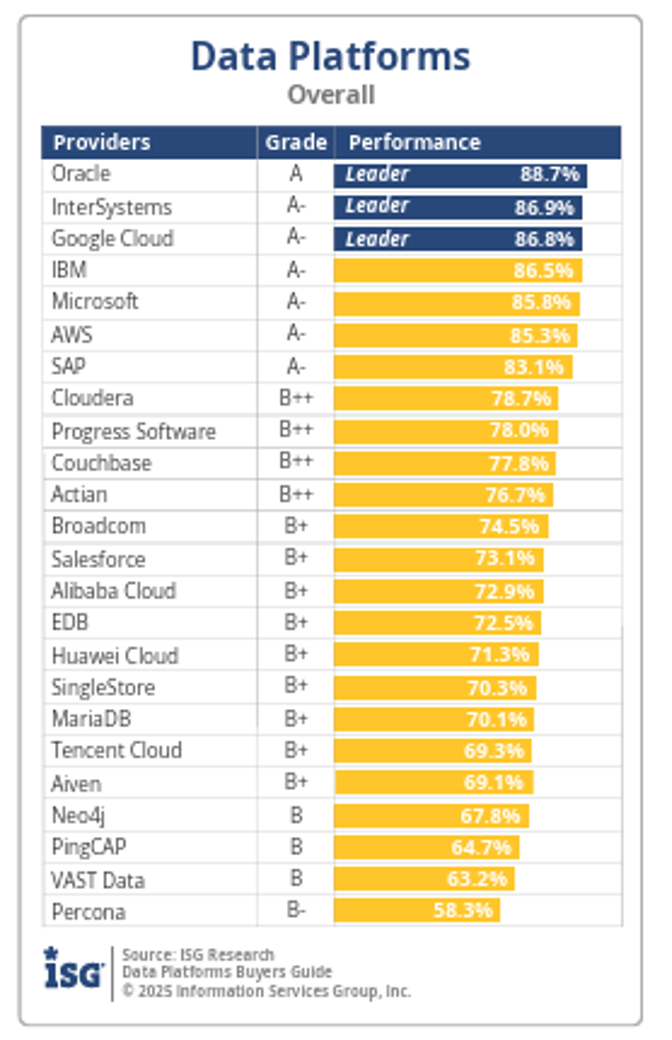

Le ISG Buyers Guide™ for Data Platforms évalue les éditeurs et produits de plateformes de données selon huit grands critères, dont la gestion des données, les capacités de requêtage et les fonctionnalités de data engineering, entre autres. Ce rapport fait le lien entre les deux thèmes : la préparation à l’IA exige une architecture de données convergente.

« Le secteur des plateformes de données a longtemps été segmenté entre, d’un côté, des plateformes opérationnelles déployées pour soutenir des applications destinées aux utilisateurs métier et aux décideurs, et, de l’autre, des plateformes analytiques généralement utilisées par les équipes data et les analystes métier pour analyser l’activité. L’importance croissante des applications opérationnelles intelligentes, pilotées par l’IA, brouille les frontières qui séparaient traditionnellement les exigences des plateformes opérationnelles et analytiques. Les utilisateurs sont de plus en plus exposés à des services data-driven qui se différencient par la personnalisation et des recommandations contextualisées. Les applications destinées aux employés suivent la même trajectoire, en ciblant les utilisateurs selon leurs rôles et responsabilités. L’évolution vers des processus métier plus agiles requiert le machine learning pour des plateformes et des applications plus réactives. Les applications intelligentes, bien qu’opérationnelles par nature, s’appuient sur un traitement analytique en temps réel pour délivrer leurs fonctionnalités : recommandations contextualisées, prédictions et prévisions fondées sur le ML, IA générative et agents.

Nous affirmons que, d’ici 2027, les fournisseurs de plateformes de données donneront la priorité au développement de capacités hybrides de traitement opérationnel et analytique afin de répondre aux exigences des applications intelligentes portées par l’IA générative. »

Chez InterSystems, nous défendons cette approche convergente de la gestion des données depuis de nombreuses années. Nous sommes donc particulièrement honorés d’être reconnus Leader par ISG, avec le deuxième meilleur score global parmi les 24 principaux fournisseurs de plateformes de données, dans leur dernier Buyer’s Guide.

Il y a beaucoup de matière dans ces rapports, et j’espère qu’ils vous apporteront des éléments utiles, applicables au sein de vos organisations, alors que vous évoluez dans ce nouveau monde — en rapide transformation — de l’IA agentique et de l’IA générative.

Mais au final, chez InterSystems, rester à la pointe de la technologie ne se résume pas à la reconnaissance des analystes : l’enjeu, c’est la réussite de nos clients. À mesure que nos clients innovent, créent de la valeur pour leurs propres clients et se différencient sur des marchés toujours plus concurrentiels, nous continuons à faire évoluer le socle data et analytique qui rend ces succès possibles.

Pour consulter ces rapports — et d’autres publications d’analystes, consulter notre page d'analystes.